Dalam era digital saat ini, penggunaan teknologi kecerdasan buatan semakin meluas dan mencakup berbagai aspek kehidupan, termasuk kesehatan mental. Berbagai aplikasi dan layanan mulai mengintegrasikan AI untuk memberikan dukungan emosional kepada penggunanya, sehingga menciptakan peluang baru di bidang ini.

Di tengah perkembangan tersebut, muncul pertanyaan penting mengenai tanggung jawab dan etika penggunaan AI, terutama saat berhadapan dengan isu-isu sensitif seperti bunuh diri. Implementasi strategi baru oleh perusahaan-perusahaan dalam menanggapi situasi kritis ini menjadi sangat menonjol.

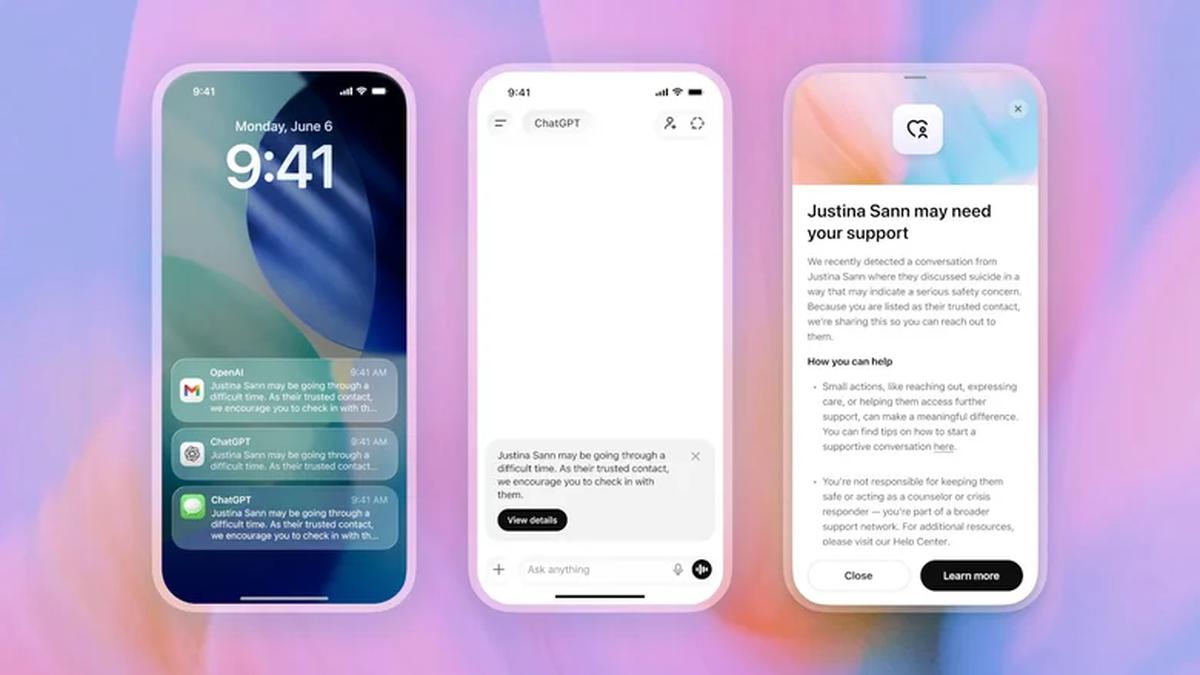

Baru-baru ini, perhatian tertuju pada langkah-langkah yang diambil oleh OpenAI dalam menangani potensi risiko kepada penggunanya. Mereka mengumumkan bahwa akan ada notifikasi kepada kontak yang ditunjuk jika terdeteksi adanya ancaman risiko signifikan terhadap kesehatan mental pengguna.

Pentingnya Tanggung Jawab dalam Penggunaan Teknologi AI

Dalam merespons kebutuhan mental pengguna, perusahaan teknologi diharapkan mengambil tanggung jawab yang serius. Komitmen ini bukan hanya mencakup pengembangan teknologi, tetapi juga pengawasan yang cermat terhadap interaksi pengguna.

Setiap deteksi ancaman harus ditangani secara langsung dan profesional untuk mencegah konsekuensi yang lebih besar. Oleh karena itu, mempertimbangkan aspek privasi dan keamanan pengguna adalah hal yang tak terelakkan dalam setiap keputusan yang diambil.

Standar keselamatan yang tinggi dalam menggunakan AI untuk dukungan emosional akan menjadi tolok ukur bagi reputasi perusahaan. Kejelasan dalam prosedur penanganan risiko ini akan membantu membangun kepercayaan dari pengguna terhadap sistem yang mereka gunakan.

Tantangan dalam Implementasi Notifikasi Keamanan Mental

Meskipun niat baik di balik pembaruan ini sangat jelas, pelaksanaannya tidak akan tanpa tantangan. Komunikasi antara sistem dan kontak yang ditunjuk perlu ditangani secara hati-hati agar tidak menimbulkan salah paham.

Di satu sisi, penting untuk memberikan informasi yang cukup kepada kontak terdekat tanpa mengganggu privasi pengguna. Di sisi lain, proses ini juga harus dilakukan dengan cepat dan efisien, agar isu yang dihadapi pengguna dapat tertangani sebelum menjadi lebih serius.

Untuk menyukseskan prosedur ini, pelatihan bagi tim yang menangani situasi krisis akan menjadi krusial. Hal ini memastikan bahwa setiap anggota tim mampu memberikan reaksi yang tepat dan empatik terhadap masalah kesehatan mental yang kompleks.

Dampak Positif Penggunaan AI untuk Kesehatan Mental

Saat teknologi AI digunakan dengan bijaksana, dampaknya terhadap kesehatan mental dapat sangat positif. Banyak pengguna merasa lebih nyaman berbicara tentang masalah mereka dengan chatbot dibandingkan dengan manusia, mengurangi rasa malu dan stigma yang sering mengintai mereka.

Sebelumnya, bantuan untuk masalah mental sering kali sulit diakses, tetapi dengan dukungan AI, individu kini dapat menjangkau sumber daya hanya dengan beberapa klik. Ini mengarah pada peningkatan kesadaran dan aksesibilitas layanan kesehatan mental secara keseluruhan.

Dengan mengintegrasikan metode berbasis AI, pendukung kesehatan mental dapat menjangkau lebih banyak orang yang membutuhkan. Hal ini memungkinkan pemberian dukungan yang lebih cepat dan tepat waktu kepada mereka yang mungkin belum pernah mencari bantuan sebelumnya.